Pesquisadores do Samsung SAIL Montreal desenvolveram o Tiny Recursive Model (TRM), um modelo de IA com apenas 7 milhões de parâmetros que supera os maiores LLMs em tarefas complexas de raciocínio. Detalhada em “Less is More: Recursive Reasoning with Tiny Networks” no arXiv, a pesquisa desafia a ideia de que “maior é melhor”, mostrando que uma arquitetura inteligente pode ultrapassar a força bruta computacional.

Fonte: https://www.arxiv.org/pdf/2510.04871

Desempenho Revolucionário nos Testes Mais Difíceis da IA

O TRM atingiu 44,6% de acurácia no benchmark ARC-AGI-1, superando modelos como DeepSeek-R1, Google Gemini 2.5 Pro e o3-mini da OpenAI, todos milhares de vezes maiores. No ARC-AGI-2, mostrou 7,8% contra 4,9% do Gemini 2.5 Pro. Em Sudoku-Extreme, obteve 87,4% de acurácia após apenas 1.000 exemplos de treino, e em navegação em labirintos 30×30 alcançou 85,3%.

Esse resultado impressionante revela que o TRM pode resolver problemas de inteligência fluida e generalizar soluções com eficiência surpreendente, consumindo menos de 0,01% dos recursos usados por LLMs gigantes.

Como Pequenas Redes Pensam Grande

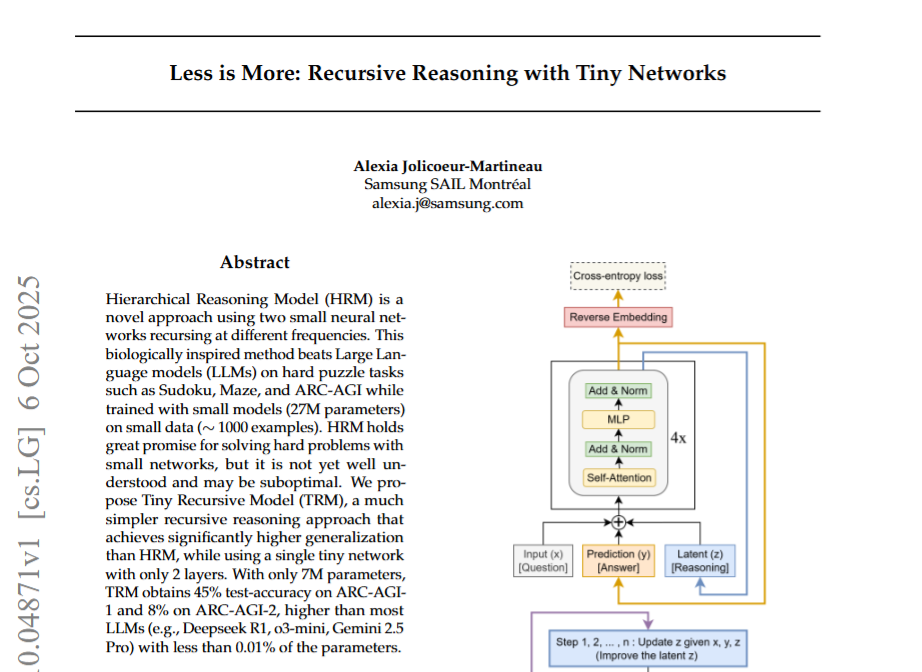

O segredo do TRM está em seu raciocínio recursivo. Em vez de gerar respostas em um único passo, o modelo inicia uma proposta e depois a refina em até 16 iterações internas. Cada ciclo utiliza um “rascunho” para criticar e melhorar a solução anterior, evitando a propagação de erros iniciais — problema comum em modelos tradicionais.

“Dependência exclusiva de grande escala e bilhões de dólares em treinamento é enganosa”, afirmou Alexia Jolicoeur-Martineau, líder do estudo. A arquitetura de duas camadas simplificadas elimina complexidades matemáticas de modelos hierárquicos anteriores, mantendo alta performance em tarefas abstratas e concretas.

Implicações e Próximos Passos

A descoberta do TRM tem potencial para revolucionar áreas que exigem raciocínio intenso, como robótica, diagnósticos médicos e planejamento estratégico, reduzindo custos de infraestrutura computacional. A Samsung planeja liberar código aberto e colaborar com a comunidade acadêmica para expandir benchmarks e explorar variantes recursivas.

Além disso, a eficiência do TRM pode gerar modelos especializados em dispositivos com recursos limitados, como drones e smartphones, abrindo caminho para IA avançada em borda sem necessidade de data centers massivos.

Fonte: Samsung Tiny Recursive Model supera LLMs gigantes em raciocínio